Christian Balkenius: Kan robotar bli moraliska?

|

15 mar 2022 |

||

Lund-Kloster Lund-Kloster

|

||

|

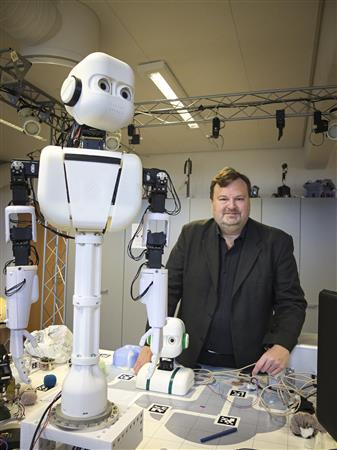

I Asimovs böcker beskrivs tre robotlagar som är tänkta som säkerhetsregler för robotar: De ska inte skada människor, de ska lyda och de ska ta hand om sig själv. Trots att böckerna tydligt illustrerar hur fel det kan gå om maskiner slaviskt följer regler utan att förstå syftet bakom dem så försöker många robotforskare använda liknande ansatser för att designa moraliska robotar. Christian Balkenius, professor i Kognitionsvetenskap, föreslår ett alternativ som grundar robotens handlingar i emotionella processer, i empati och i en förståelse för andra. Potentiellt kan robotar ges möjlighet att lära sig sociala normer och moraliskt beteende från människor i sin omgivning. Hur går detta till? Christian ger oss svar.

Christian Balkenius forskar om inlärning, uppmärksamhet och emotioner i människor och robotar. Han är också ansvarig för forskarskolan inom det tvärvetenskapliga och nationella programmet WASP-HS i vilket 70 doktorander studerar konsekvenserna av artificiell intelligens för individ och samhälle. Mer information om WASP-HS finns här: https://wasp-hs.org